Gli attuali modelli linguistici di grandi dimensioni funzionano grazie a un meccanismo chiamato Attention, che analizza simultaneamente tutte le parole di una frase per stabilire legami e significati. Questo metodo garantisce accuratezza, ma richiede una potenza di calcolo enorme, poiché ogni parola viene confrontata con tutte le altre.

È anche il motivo per cui questi sistemi consumano così tante risorse energetiche e necessitano di hardware potente, spesso basato su GPU NVIDIA. L’idea dietro SpikingBrain1.0 è diversa: invece di processare l’intera frase, il modello concentra l’attenzione solo sui termini circostanti, un po’ come fa il cervello umano quando interpreta un contesto. In questo modo si riduce lo spreco di calcolo, si attivano solo le “connessioni” necessarie e si ottiene un processo molto più rapido ed efficiente.

Secondo i ricercatori cinesi che lo hanno sviluppato, SpikingBrain1.0 è fino a 100 volte più veloce rispetto a modelli consolidati come quelli dietro ChatGPT o Copilot. Non solo: questo sistema può essere addestrato con meno del 2% dei dati richiesti dalle architetture attuali e raggiungere comunque prestazioni simili.

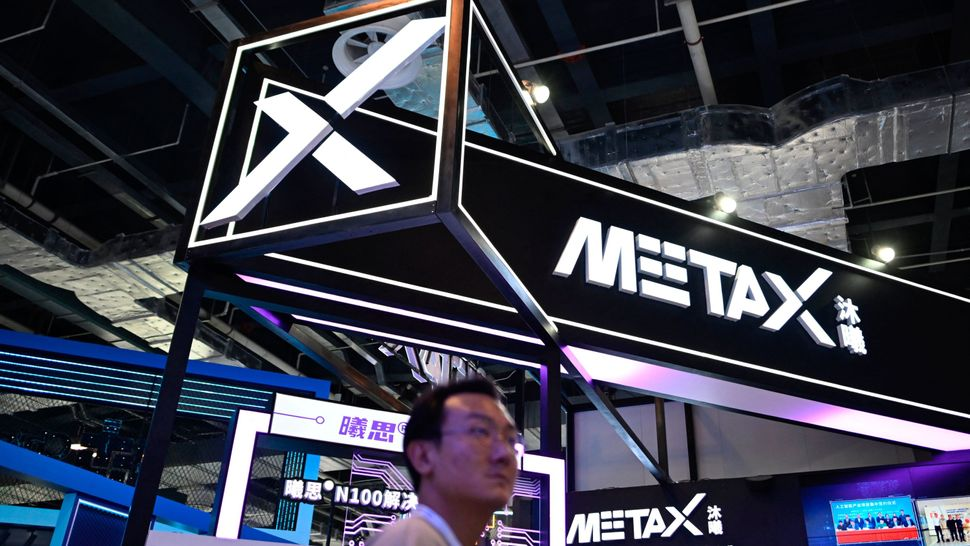

Un altro aspetto rilevante è che non dipende dall’hardware NVIDIA, ma sfrutta chip sviluppati localmente da MetaX, un punto cruciale per l’autonomia tecnologica cinese. Se i risultati verranno confermati, ci si troverebbe di fronte a una vera svolta, non soltanto per la velocità, ma anche per la sostenibilità e per la possibilità di ridurre i costi e l’impatto energetico dell’intelligenza artificiale.